向量与AI

应用及介绍

在 OpenAI 官网上专门有 Embedding(向量化) 的介绍,并且提供了相关的模型API,叫做 ada,专门将数据 Embedding。

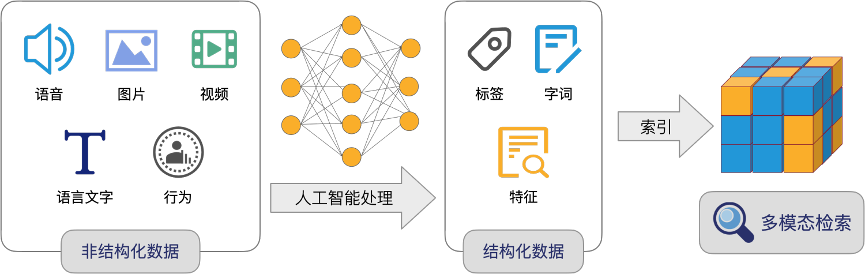

这些向量如同数学空间中的坐标,标识着各个实体和实体关系。我们一般将非结构化数据变成向量的过程称为 Embedding,而非结构化检索则是对这些生成的向量进行检索,从而找到相应实体的过程。

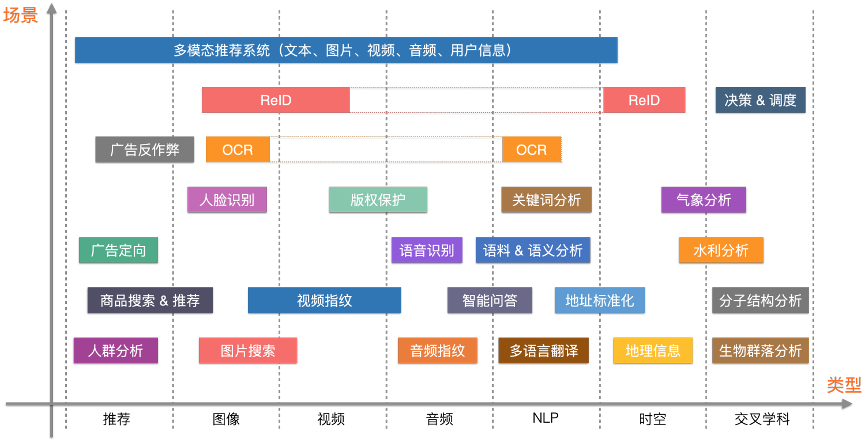

非结构化检索本质是向量检索技术,其主要的应用领域如人脸识别、推荐系统、图片搜索、视频指纹、语音处理、自然语言处理、文件搜索等。

随着 AI 技术的广泛应用,以及数据规模的不断增长,向量检索也逐渐成了 AI 技术链路中不可或缺的一环,更是对传统搜索技术的补充,并且具备多模态搜索的能力。

向量检索的应用场景远不止上面提到的这些类型。

如下图所示,它几乎覆盖了大部分的可以应用AI的业务场景。

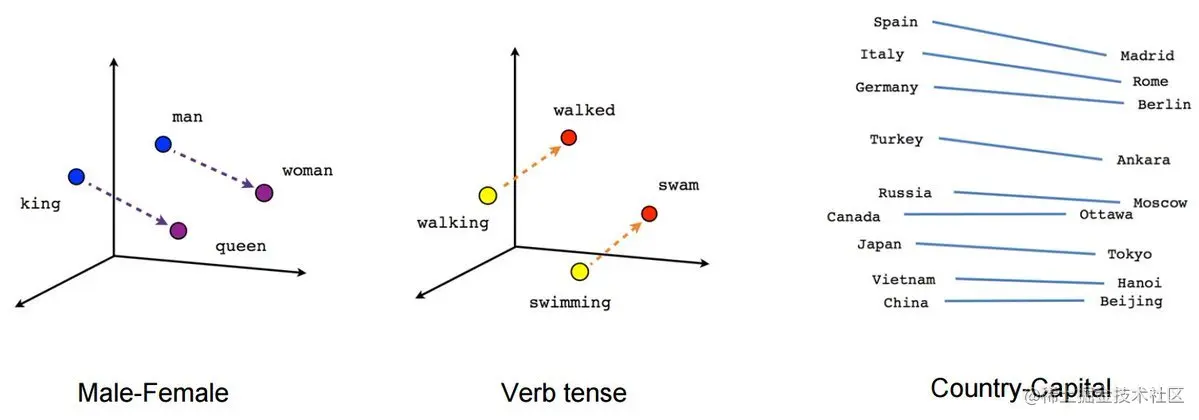

Embedding 是用一个低维稠密向量来表示一个对象,使得这个向量能够表达相应对象的某些特征,同时向量之间的距离能反应对象之间的相似性。

Embedding 是一个多维向量数组,由一系列数字组成,通过相关的算法可以将文本、音频、视频等内容转换为多维向量数组,并最终存储到向量数据库中。

假设 man的向量数组可表示为 [0.1,0.2,0.1],woman的向量数组可表示为[0.3,0.1,0.1]。

下图中可以看到这些多维向量在向量空间中的关系,man和woman之间、king和queen之间,China和Beijing之间。

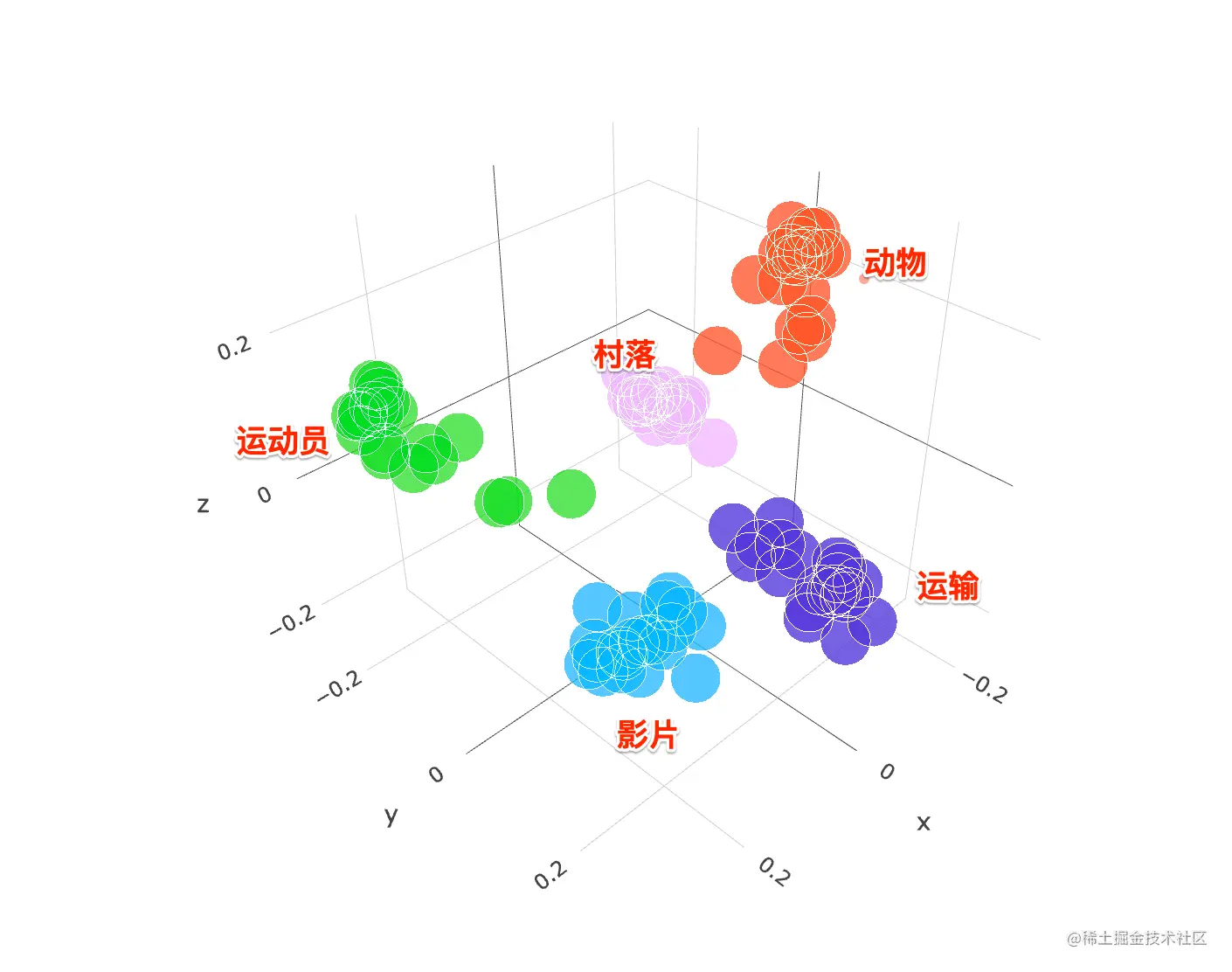

各种各样的内容进行向量化之后,最终在向量空间会形成或近或疏的关系。比如下面这幅图中可以看出,如果你搜索一个动物相关的内容,肯定(大概率)不会匹配到运动员的那一堆数据中。

向量化的过程是一个复杂的过程,通常会用到经过大量训练和优化的大模型以及神经网络等厉害的技术,所以,个人或普通公司只能用大厂提供的付费服务,例如OpenAI 的 Ada 模型。

为什么这么复杂呢,比如基于自然语言处理的方式向量化,不仅要分析文本本身的意思,还会包括情感分析、翻译等工作要处理,例如你搜索英文的 apple,也要能匹配上中文的苹果或其他的语种。还有如果你搜索苹果太难吃了,要不能匹配出苹果太棒了这种结果吧。

向量化方法

矩阵分解法

矩阵分解法是一种常见的 Embedding 方法,它可以将高维的矩阵映射成两个低维矩阵的乘积,很好地解决了数据稀疏的问题。

基于自然语言处理的方法

自然语言处理(NLP)是一种人工智能技术,它涉及计算机对人类语言的理解和生成。NLP 包括许多任务,如文本分类、情感分析、命名实体识别、机器翻译和自动摘要等。NLP 技术可以帮助计算机处理和分析大量的文本数据,从而使计算机能够更好地理解人类语言并作出更准确的预测和决策。而基于 NLP 的 Embedding 方法的主要思想是将每个单词或短语映射到一个低维向量空间中,使得在这个向量空间中,相似的单词或短语在距离上更加接近,以便于支持语义查找与分析工作。常见的方法包括:

- Word2vec(每个单词生成一个原子实体,生成一个向量)

- GloVe(Global Vectors for Word Representation)(基于大量训练,不适应处理训练之外的新词汇)

- FastText(单词由多因素组成,可以处理没有接触过的新词汇)

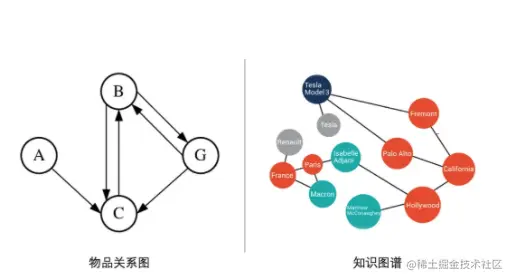

基于图的方法

上述方法都是针对序列文本而设计的,而对于诸如社交网络分析、推荐系统、知识图谱等领域中的问题,如下图所示,数据对象之间更多呈现出图结构:

基于图的 Embedding 技术是一种将图数据(通常为高维稠密的矩阵)映射为低微稠密向量的过程,能够很好地解决图数据难以高效输入机器学习算法的问题。Graph Embedding 技术将图中的节点以低维稠密向量的形式进行表达,要求在原始图中相似 (不同的方法对相似的定义不同) 的节点其在低维表达空间也接近。常见的方法包括:

- DeepWalk

- Node2vec

- Metapath2vec

向量数据库的特点

向量数据库的应用场景决定了其大概率需要存储海量的数据,而不是想关系型数据库那样存储确定的多少条数据。

- 向量数据库要具具有高可用、高扩展性的架构;

- 向量数据库是计算密集型应用,需要良好的硬件设备加速;

- 高并发、低延迟

应用场景

向量数据库的核心功能就是相似性匹配,所以,它的应用场景也是围绕着这个功能来的。

- 文本搜索(包含语义的那种),最常见的功能;

- 图片、语音、视频搜索,例如那种以图搜图的功能,当然,与之匹配的向量化的过程也比文字更复杂,例如语音的向量化要包括对语音进行特征化的提取,比如声纹等等。歌曲识别(非歌词的那种)就可以用向量化和向量数据库;

- 推荐系统,根据系统给用户打的标签,给用户推荐相似度最高的商品、服务等;

- 异常检测,相似度过低可以判断为异常,例如人脸识别功能,如果相似度过低,那可能就是非本人;

向量数据库发展与使用

向量数据库的工作原理

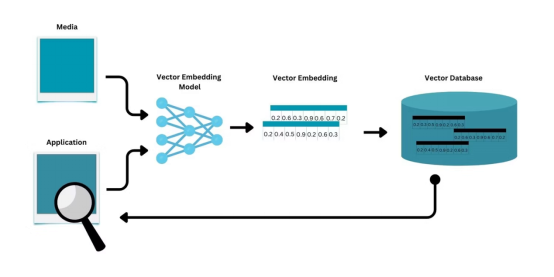

从生成向量Embedding 到从向量数据库查询数据,您的数据经历了三个步骤:

1. 向量Embedding 的创建:基于数据类型,向量Embedding 模型用来生成有待索引的向量Embedding 。这些Embedding 模型将文字、图像、视频和音频转换成数字/Embedding 。

2. 索引:一旦向量Embedding 已生成,它们现在可以存储在Pinecone、Milvus和Chroma之类的向量数据库上。这些向量数据库使用各种算法,比如产品量化(PQ)和位置敏感散列(LSH),对每个Embedding 进行索引,以便快速有效地存储和检索数据。

3. 查询:当应用程序发出查询时,该查询必须先经过用于生成存储在向量数据库上的数据的同一个向量Embedding 模型。生成的向量查询随后被放到向量数据库上,然后检索最接近的向量作为最合适的查询结果。

流行的向量数据库

随着公开可用的预训练模型呈爆炸式增长,向量数据库随着这些模型的功能增加和微调速度而迅速流行起来。由于用户对向量数据库的需求很大,许多公司已经开发了自己的向量数据库服务,下面是一些最受欢迎的向量数据库:

- Pinecone:一种为快速相似度搜索而设计的云原生向量数据库。它具有高可扩展性、分析能力和实时洞察力,非常适合推荐系统和图像搜索。

- Milvus:一种着眼于相似度搜索和AI应用的开源向量平台。它为高维向量提供了快速有效的索引和搜索功能。此外,Milvus支持多种索引算法,并为各种编程语言提供SDK。

- Redis:一种高性能向量数据库,能够支持实时应用程序、会话管理和高流量网站。Redis经常用于实时分析、相似度搜索和推荐系统。

- Weaviate:提供模式发现、实时更新、语义搜索和数据上下文化。由于这些功能,Weaviate经常被用来为应用程序创建个性化的体验系统。